2026 年首樁矚目 AI 晶片 IPO 由 Cerebras 打頭陣,端出與 OpenAI 2,460 億美元合約與超大型晶圓級晶片搶市,但估值高達約 70 倍營收、產能與單一客戶風險巨大。同時,Nvidia 下一代 Vera Rubin 平台高度仰賴 SK Hynix 主導的 HBM4 供應鏈,AI 算力競賽正從 GPU 延伸到記憶體與晶圓代工全產業鏈。

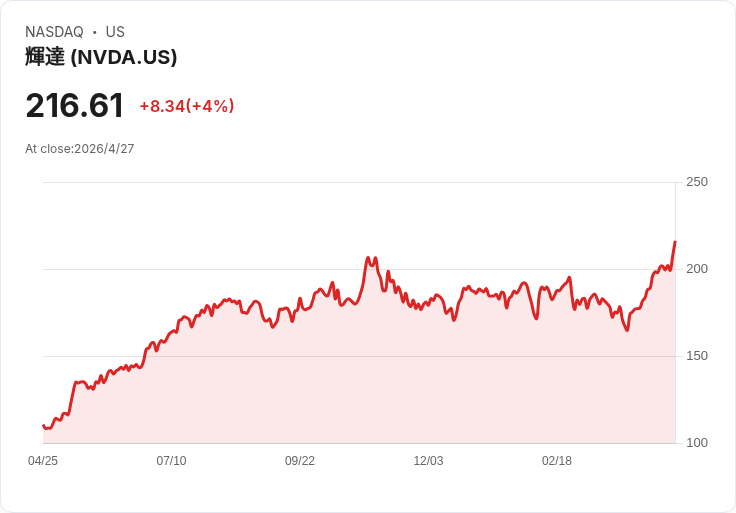

生成式 AI 帶動的算力戰,正從「誰的 GPU 更快」悄悄轉向「誰能做出更快、更省電、供貨最穩的 AI 系統」。2026 年第一樁話題 AI 晶片 IPO,即將由新創公司 Cerebras 打頭陣,挑戰資料中心霸主 Nvidia (NASDAQ: NVDA)。同一時間,Nvidia 自家下一代 Vera Rubin 平台,又在高速記憶體 HBM4 上高度押注 SK Hynix,讓整條供應鏈面臨前所未有的集中風險。

Cerebras 近日已向美國證券交易委員會(SEC)遞交 S-1 文件,顯示上市腳步逼近。這家公司最大的賣點,是它完全顛覆傳統 GPU 的「晶圓級」AI 晶片架構。一般 GPU 是把一片矽晶圓切成多顆晶片,Cerebras 則反其道而行,把整片晶圓當作一顆超大型晶片使用。根據其申報資料,這種 wafer-scale engine 尺寸約為 Nvidia Blackwell B200 封裝的近 30 倍,晶體管數量更高出 19 倍,將大量運算核心與記憶體直接整合在同一片矽上。

這種設計的核心訴求,是大幅降低 AI 模型運算時的資料傳輸成本。傳統資料中心往往需要部署數千顆 GPU,相互之間透過高速網路交換資料,不只耗電、延遲高,整體系統打造與維運成本驚人。Cerebras 主張,把更多核心與記憶體鎖在同一顆晶片內,可節省大量外部網通與封裝開銷,在推論(inference)場景上速度可達主流 GPU 解決方案的 15 倍,且更省電、更易管理,對講求回應時間的「推理模型」尤其關鍵。

也因為技術敘事強烈,Cerebras 已拿下兩筆重量級合約。其一是與 OpenAI 達成總額約 2,000 億美元等級的長約,自 2026 至 2028 年提供 750 MW 推論算力,並有機會在 2030 年前再追加 1.25 GW 容量;其二則是與 Amazon (NASDAQ: AMZN) 合作,將 Cerebras 的 CS-3 系統導入雲端平台 AWS,並與其自研 Trainium3 晶片整合。憑藉這兩大客戶,其財報中「尚未履約義務」帳面金額高達 246 億美元,對去年營收僅 5.1 億美元的新創而言,是極具想像空間的「爆發庫存」。

然而,這些數字現在都還不是收入,而是需要多年兌現的承諾。風險首先來自執行難度。要在短時間內為 OpenAI 擴建龐大資料中心、佈建電力與冷卻、確保系統穩定運轉,對過去沒有同等規模經驗的 Cerebras,是極具挑戰的工程。任何交付延宕或效能不如預期,都可能讓 OpenAI 調降採購,進而侵蝕整個商業故事的基礎。

第二個關鍵風險在供應鏈。Cerebras 的晶圓級晶片完全仰賴 Taiwan Semiconductor Manufacturing (NYSE: TSM) 生產,目前使用 5 奈米製程,未來還得跟著 TSMC 一同轉向 3 奈米。由於 wafer-scale 良率天生較低,一個微小瑕疵就可能報廢整片晶圓,再加上 TSMC 需要兼顧包括 Nvidia 在內多家大型客戶的高階產能分配,Cerebras 想要順利擴產,恐怕得在價格與交期上付出不小代價。

再者,Cerebras 的營運高度集中於 OpenAI 單一客戶,其龐大訂單固然讓財報看起來亮眼,卻也埋下「客戶集中度過高」的結構風險。若未來無法快速擴大其他雲端客戶或企業採用,任何 OpenAI 策略調整,都可能對公司營運造成致命衝擊。市場傳出,Cerebras IPO 估值可能上看 350 億美元,約為過去一年營收 70 倍本益比,遠高於 Nvidia 目前約 23 倍的歷史營收倍率,也顯示估值中已高度反映未來成長預期。

與此同時,身為既有霸主的 Nvidia 則把籌碼押在下一代 Vera Rubin 平台上,盼進一步鞏固資料中心市占。但 Vera Rubin 真正關鍵並不在 GPU 本身,而在其背後的高速記憶體 HBM4。該平台要達成外界預期的效能指標,必須搭配速率超過 10Gb/s 的新一代 HBM4 堆疊記憶體,否則整體算力與能效都難以完全發揮。

問題在於,現階段能夠量產 HBM4 的廠商屈指可數,且市況已呈現高度集中。業界訊息顯示,SK Hynix 目前掌握約 70% 初期 HBM4 供給份額,Samsung Electronics 雖已通過 Nvidia 認證,但先前在良率與認證節奏上的落後,讓其在初期供應上仍屬次要角色;Micron Technology 雖宣布啟動 HBM4 量產,但在供應比重上仍難撼動 SK Hynix 與 Samsung 的領先地位。

SK Hynix 為搶下這波 AI 記憶體紅利,大手筆在清州興建名為 P&T7 的先進封裝巨型廠,投資金額高達約 128.5 億美元,並與 TSMC 共同開發 HBM4 基板與邏輯製程整合,希望把 HBM 堆疊與 GPU/邏輯晶片封裝集中在同一個產線,縮短交期、提升封裝效率。這讓 SK Hynix 深度鎖進 Nvidia 的核心製造鏈條,從 GPU 設計、邏輯製程到記憶體封裝緊密串連。

風險在於,這同樣是一場「押上全部」的大賭注。若 HBM4 良率不如預期,或與 TSMC 的整合出現瑕疵,SK Hynix 的供應優勢恐怕瞬間瓦解。但迄今為止,市場數據顯示,該公司在第一季交出高達 72% 的營業利益率,已遠超多數半導體同業,凸顯 AI 記憶體從週期性商品,正快速轉型為具定價權的「關鍵基礎設施」。

綜合來看,AI 晶片戰局已不再只是單純的「誰的 GPU 更強」。Cerebras 嘗試用革命性的晶圓級架構與 OpenAI 超大合約突圍,但必須面對產能、單一客戶與估值過熱三重壓力;Nvidia 則在穩固霸主地位的同時,把命脈綁在 SK Hynix 與 HBM4 供應鏈上,一旦良率或擴產出現意外,整個 Vera Rubin 節奏都可能被打亂。

對投資人而言,當前 AI 硬體賽局的關鍵不只在技術參數,更在於供應鏈掌控力與執行力。Cerebras 能否如期兌現 2,460 億美元級別的履約義務?SK Hynix 是否能持續維持超高毛利與主導地位?Nvidia 又能否在依賴關鍵供應商的前提下維持產品節奏?這些問號,將在未來幾季的產能爬坡、實際交付與新一輪財報中,逐一揭曉。眼下可以確定的是,AI 晶片的勝負,已經從實驗室走向工廠產線,也從單一公司擴散為整條產業鏈的聯合作戰。

點擊下方連結,開啟「美股K線APP」,獲得更多美股即時資訊喔!

https://www.cmoney.tw/r/56/9hlg37

本網站所提供資訊僅供參考,並無任何推介買賣之意,投資人應自行承擔交易風險。

發表

發表

我的網誌

我的網誌